In-Memory Cache ve Dağıtık Sistemlerde Veri Tutarsızlığı: Çözüm Yolları

Web uygulamalarında yüksek performans ve hızlı veri erişimi sağlamak için in-memory cache (bellek içi önbellek) kullanımı oldukça yaygındır. Ancak, birden fazla sunucuda çalışan uygulama örnekleriyle cache yönetimi daha karmaşık hale gelir. Bu yazıda, in-memory cache kullanımında karşılaşılan veri tutarsızlığı problemleri ve çözüm yollarını detaylı bir şekilde inceleyeceğiz.

In-Memory Cache Nedir?

In-memory cache, verileri uygulamanın RAM’inde (belleğinde) tutarak hızlı veri erişimi sağlamayı amaçlayan bir tekniktir. RAM’e veri yazmak ve okumak, sabit diskten veri okuma işlemine göre çok daha hızlı olduğu için, sık erişilen verilerin bellekte tutulması uygulamanın hızını önemli ölçüde artırır.

In-Memory Cache’in Çalışma Prensibi

Bir uygulama çalışırken, veriye erişmeden önce cache’de (bellekte) verinin olup olmadığı kontrol edilir. Eğer veri cache’de yoksa, veritabanından alınır ve bu veri kullanıcıya gösterilmeden önce RAM’e kaydedilir. Sonraki kullanıcılar aynı veriye ihtiyaç duyarsa, veri veritabanına bağlanmak yerine cache’den alınır, bu da işlemin daha hızlı yapılmasını sağlar.

Yüksek Performans ve Cache Miktarı

Cache’in etkinliği, sunucunun RAM miktarına bağlıdır. Örneğin, 2GB’lık RAM’e sahip bir sunucuda yalnızca sınırlı miktarda veri cache’lenebilir. Bu, uygulamanın tuttuğu verilerin sayısı arttıkça RAM’in dolmasına ve eski verilerin silinmesine yol açar. Bu durum, cache’de tutulan verilerin sıklıkla değişmesi gerektiği anlamına gelir.

Farklı Sunucularda Çalışan Instance’lar ve Veri Tutarsızlığı Sorunu

Şimdi, aynı uygulamanın farklı sunucularda çalışan iki örneğini (instance) ele alalım. Diyelim ki A ve B adında iki farklı sunucuda aynı uygulama çalışıyor. Bu iki sunucu load balancer aracılığıyla gelen istekleri alır.

1. A Sunucusuna Gelen İlk İstek

Saat 10:00'da load balancer, gelen isteği A sunucusuna yönlendirir. Bu istek ile veritabanına bağlanılır ve gerekli veri alınarak A sunucusunun cache’ine kaydedilir. Şu an A sunucusunda saat 10:00’da çekilen veri mevcut.

2. B Sunucusuna Gelen Sonraki İstek

Saat 11:00’de, load balancer bu sefer gelen isteği B sunucusuna yönlendirir. Ancak, B sunucusunda cache’te bu veri bulunmadığı için veritabanına tekrar bağlanılır ve yeni bir veri alınır. Bu veri, B sunucusunun cache’ine kaydedilir.

3. Veri Tutarsızlığı Durumu

Eğer saat 10:00’da alınan veri ile saat 11:00’de alınan veri aynıysa, herhangi bir problem olmaz. Ancak, veritabanında değişiklik yapılmışsa (örneğin, veri güncellenmişse), A ve B sunucularındaki veriler farklı olabilir. Bu durumda, veri tutarsızlığı oluşur.

Örnek:

- A sunucusundaki cache, saat 10:00'da veritabanından alınan veriyi tutarken,

- B sunucusundaki cache, saat 11:00'de yeni alınan veriyi tutuyor.

Bu durumda, A ve B sunucularındaki veriler farklı olabilir. Kullanıcılar, hangi sunucuya yönlendirilirse, o sunucudaki cache verisini görecekleri için, farklı kullanıcılar farklı veri görebilir.

Veri Tutarsızlığını Engelleme Yolları

Veri tutarsızlığını engellemek için bazı çözüm yolları mevcuttur. Bunlardan en yaygın olanları şunlardır:

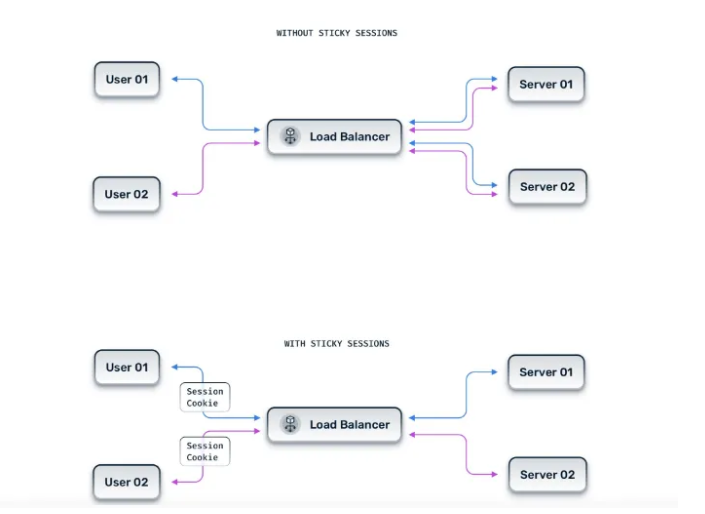

1.Sticky Session (Yapışkan Oturum) Kullanımı:

Load balancer’a kullanıcı ilk kez bir sunucuya yönlendirildiğinde, tüm sonraki isteklerin aynı sunucuya yönlendirilmesi talimatı verilebilir. Bu sayede, bir kullanıcının ilk isteği hangi sunucuya yönlendirilirse, sonraki istekleri de aynı sunucuya gider. Bu, cache tutarlılığı sağlayarak, kullanıcının farklı veri görmesini engeller.

Örnek:

- Kullanıcı ilk isteğini A sunucusuna yaptı ve veriyi aldı.

- Sticky session sayesinde, sonraki istekleri A sunucusuna yönlendirilir, böylece kullanıcı her zaman aynı cache verisini görür.

2. Dağıtık Cache Kullanımı:

Distributed cache (dağıtık cache) kullanarak, tüm sunucular arasında cache verisi paylaşılabilir. Bu durumda, cache’deki veri her iki sunucuda da aynı olur ve veri tutarsızlığı problemi ortadan kalkar. Popüler dağıtık cache çözümleri arasında Redis ve Memcached bulunmaktadır.

Örnek:

- A ve B sunucuları Redis gibi bir dağıtık cache kullanarak cache verisini paylaşır.

- Veritabanından alınan veri her iki sunucuda da güncellenir, böylece kullanıcı hangi sunucuya yönlendirilirse yönlendirilsin, aynı veri görüntülenir.

3. Cache Expiration (Önbellek Süresi Sonu) ve Cache Invalidasyonu:

Cache’deki verilerin belli bir süre sonra otomatik olarak silinmesini sağlamak, verinin güncel olmasını garanti eder. Ayrıca, veritabanındaki veriler güncellenmişse, ilgili cache de invalid edilerek güncellenebilir.

Örnek:

- Cache’de tutulan verinin 5 dakika sonra geçerliliği sona erer ve cache otomatik olarak temizlenir.

- Veritabanındaki veri değiştiğinde, cache manuel olarak silinir veya güncellenir.

Sonuç:

In-memory cache, veritabanı sorgularını hızlandırarak uygulamanın performansını artırır, ancak farklı sunucularda çalışan instance’lar arasında cache yönetimi, veri tutarsızlığı gibi sorunlara yol açabilir. Bu sorunların üstesinden gelmek için sticky session, dağıtık cache ve cache invalidasyonu gibi çözümler kullanılabilir.

Web uygulamanızda yüksek performans ve veri tutarlılığı sağlamak için bu çözümleri değerlendirmeniz, uygulamanızın daha güvenilir ve verimli çalışmasını sağlayacaktır.

Yorumlar